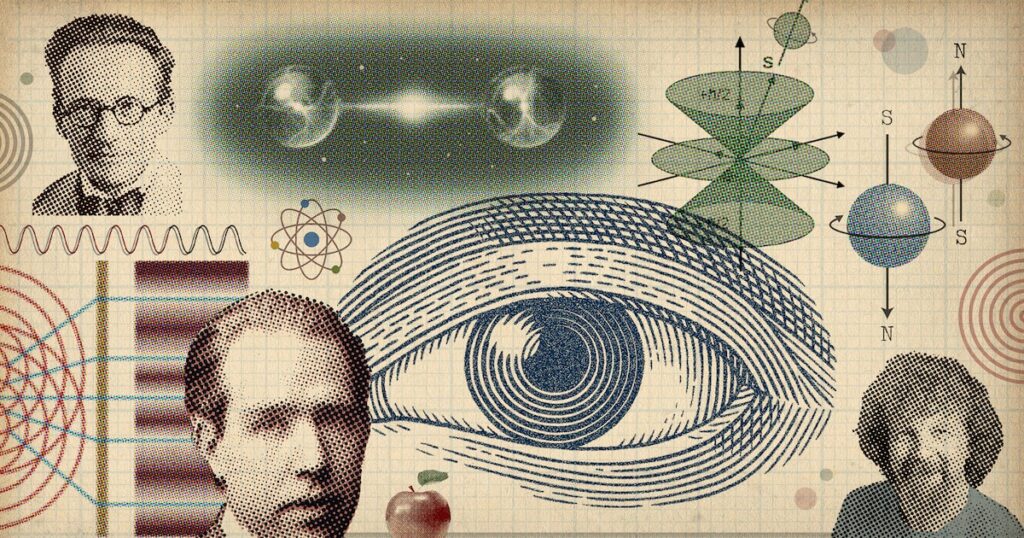

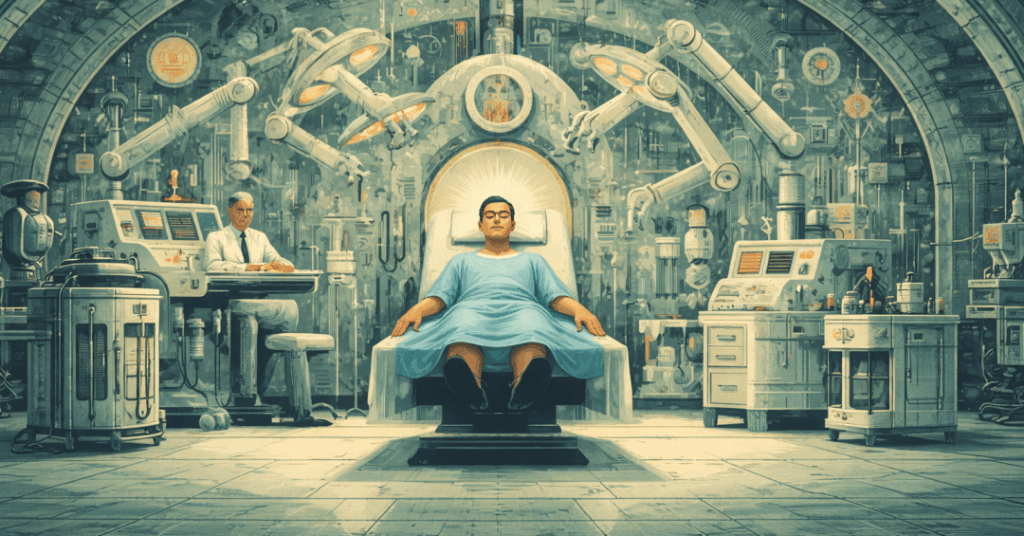

Concepção artística de uma versão robótica de Sigmund Freud, o “pai da psicanálise” – Ilustração: Paulo Silvestre

Preferimos mentiras reconfortantes que verdades inquietantes. Essa característica intrínseca da humanidade ganha força com os algoritmos das redes sociais e, mais recentemente, com a influência crescente sobre nós da inteligência artificial, manifestando-se de diferentes maneiras. Uma das mais perigosas é o fenômeno das “terapias por IA”.

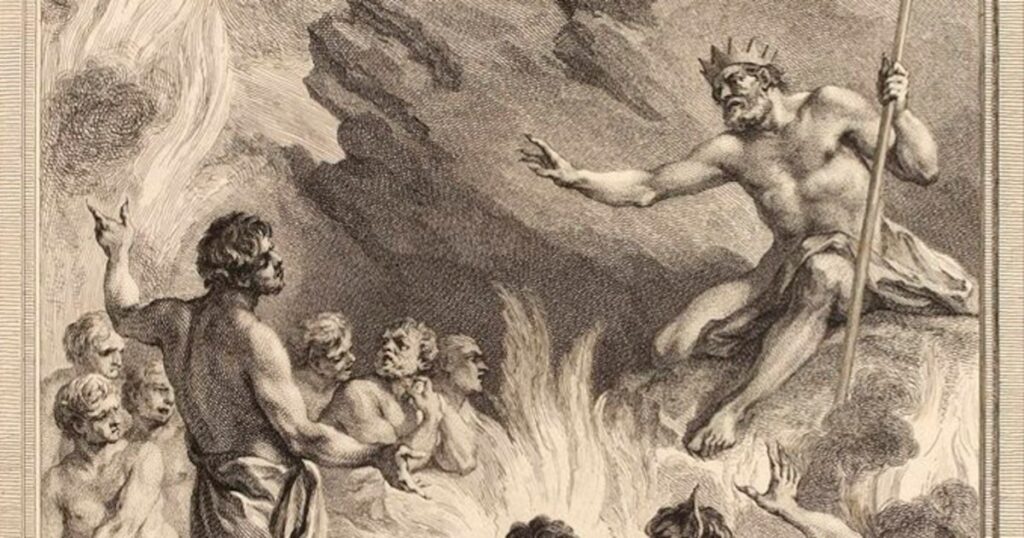

Esse comportamento já havia sido descrito por Sigmund Freud em 1921, em “Psicologia das Massas e Análise do Eu”. Na sua obra clássica, o “pai da psicanálise” disse que “as massas nunca tiveram sede da verdade. Requerem ilusões, às quais não podem renunciar. Nelas o irreal tem primazia sobre o real, o que não é verdadeiro as influencia quase tão fortemente quanto o verdadeiro. Elas tendem visivelmente a não distinguir entre os dois.”

Essa afirmação perturbadora ajuda a explicar como tantas pessoas abraçam teorias de conspiração absurdas, apenas porque lhes satisfazem alguma necessidade. Não se trata de algo passageiro ou inconsequente: o pensamento freudiano combina com a organização das redes sociais e da inteligência artificial, que podem reforçar vieses e perturbações dos indivíduos.

Ao substituírem psicólogos pela IA generativa, as pessoas não buscam confronto com a realidade, mas alívio imediato de angústias. Já um psicólogo não oferece apenas palavras gentis, e sim um processo de desconstrução, reflexão e até de desconforto produtivo. Sua função é justamente desafiar narrativas internas ilusórias, apontar padrões prejudiciais e, de modo ético, levar o paciente a percepções reais, o que pode doer, mas gera mudança.

Plataformas como ChatGPT ou Gemini foram desenhadas para serem agradáveis e manter o usuário engajado. Não se guiam pela ética de um psicólogo. Dizem exatamente o que a pessoa quer ouvir, um consolo imediato que, em vez de resolver o problema, pode reforçar ilusões.

Isso pode transformar essas plataformas em substitutos terapêuticos que atrasam tratamentos necessários, geram dependência emocional e perpetuam sofrimentos. É o equivalente digital das ilusões reconfortantes de Freud.

Estamos iniciando mais um “Setembro Amarelo”, campanha internacional de prevenção do suicídio, estimulando o diálogo sobre saúde mental. Por isso, a despeito dos incríveis benefícios que a inteligência artificial nos proporciona, não se pode ignorar os riscos do abuso de tanto poder em “terapias”.

Já se fala de “psicose de IA” para descrever casos de pessoas que aparentemente perderam contato com a realidade após o uso intenso desse recurso. Não se trata de uma classificação científica, mas explica tantas pessoas formando crenças comprovadamente falsas ou criando relações intensas com personalidades que só existem na IA.

Há casos documentados de indivíduos que desenvolvem delírios de grandeza ou sentimentos paranoicos após longas conversas com uma plataforma de IA. Em muitas ocasiões, isso acontece após “sessões de terapia” com os robôs.

Esses sistemas são criados com uma intenção deliberada de parecerem pessoas. O marketing das big techs promove ativamente a antropomorfização da tecnologia: ao atribuírem características humanas a uma máquina, os indivíduos se sentem mais à vontade com ela e, assim, usam mais o produto.

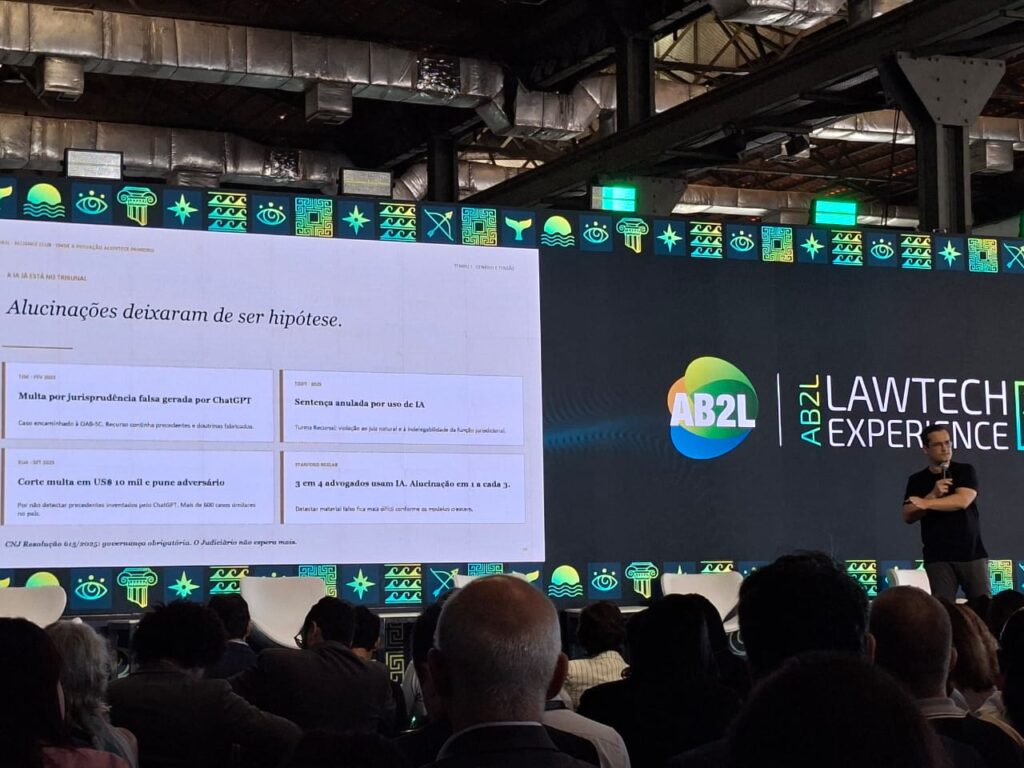

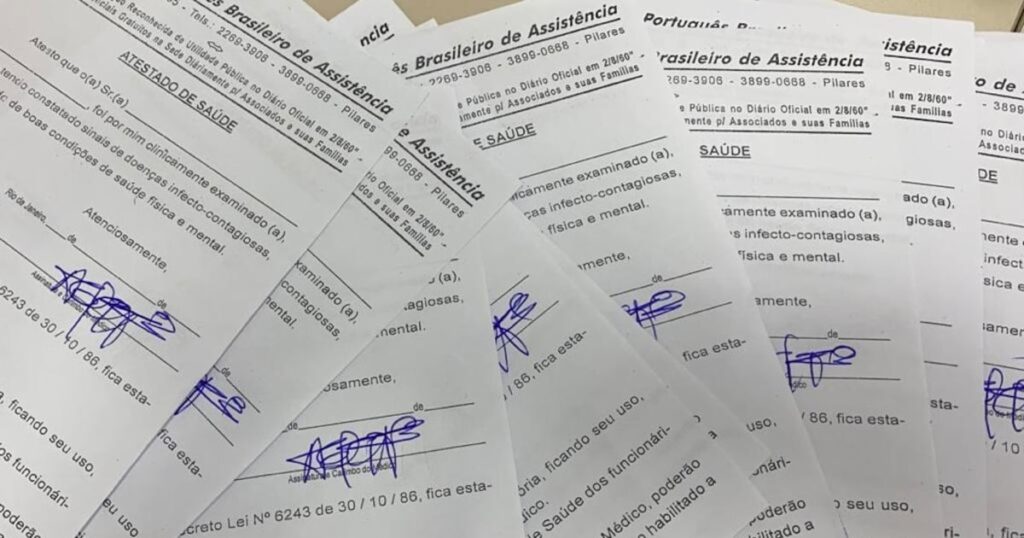

Por mais que essa tecnologia busque as melhores respostas, é comum que elas sejam imprecisas ou completamente erradas. E essas empresas não se sentem obrigadas a evitar as consequências desses usos abusivos de seus produtos, pois nada lhes acontecerá, mesmo que alguém se suicide “incentivado” pela IA.

Assim, as pessoas engrossam as estatísticas da “psicose de IA”. É por isso que as big techs precisam ser responsabilizadas pelas consequências de seus produtos. A indústria digital se acostumou a pairar sobre as leis que regulam a sociedade e todos os outros setores da economia, o que é particularmente problemático em algo que tem tamanha influência sobre todos nós.

Se você convive com alguém que passa por um quadro assim, não o julgue. Pelo contrário, acolha, demonstre empatia. Ofereça alternativas e sugira que a pessoa busque ajuda de um profissional humano.

A inteligência artificial está transformando o mundo de muitas maneiras positivas. Mas não podemos usá-la para nos afundarmos em ilusões que nos confortem. Fora das telas, a realidade continua se impondo, e precisamos de mecanismos que nos ajudem a conviver de forma saudável com seus desafios.

Vídeo relacionado: