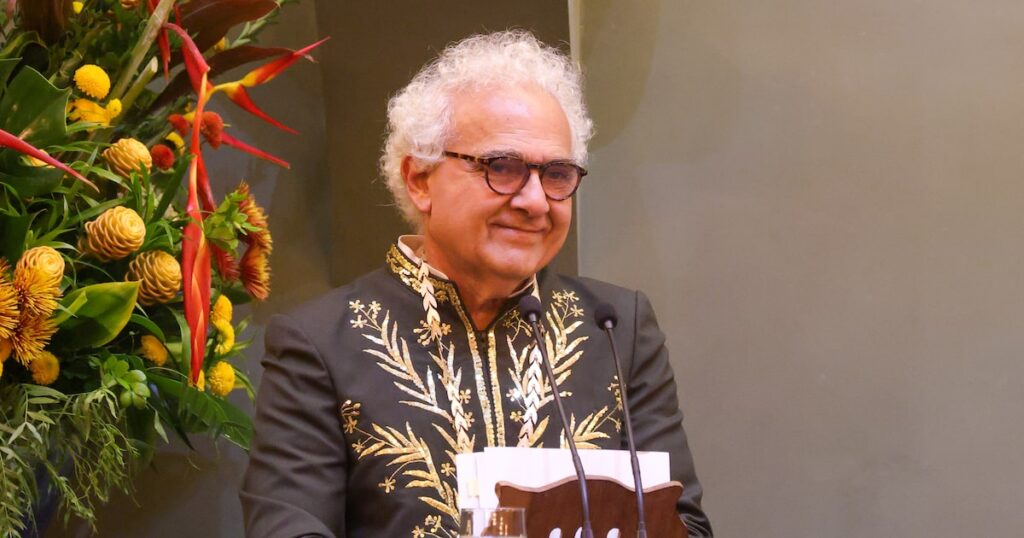

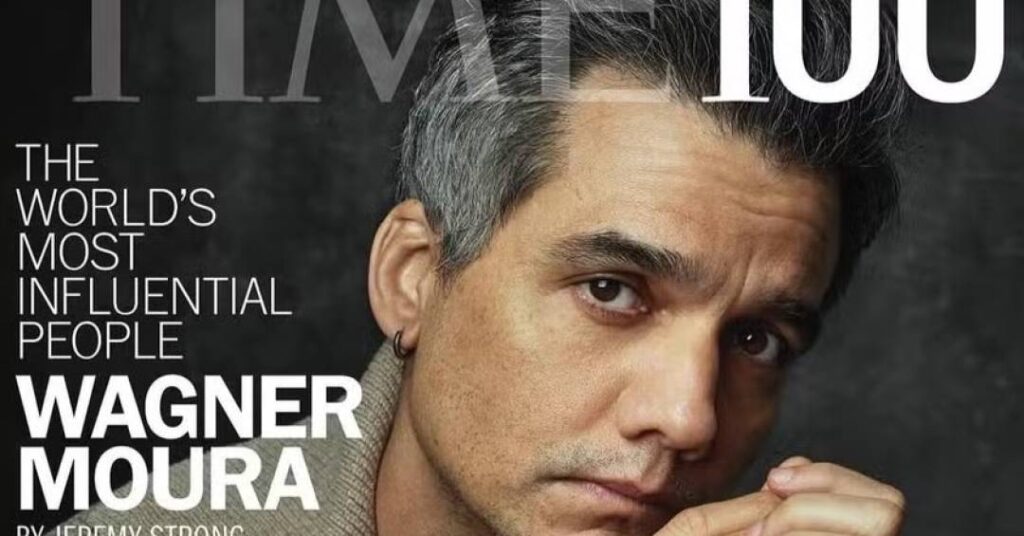

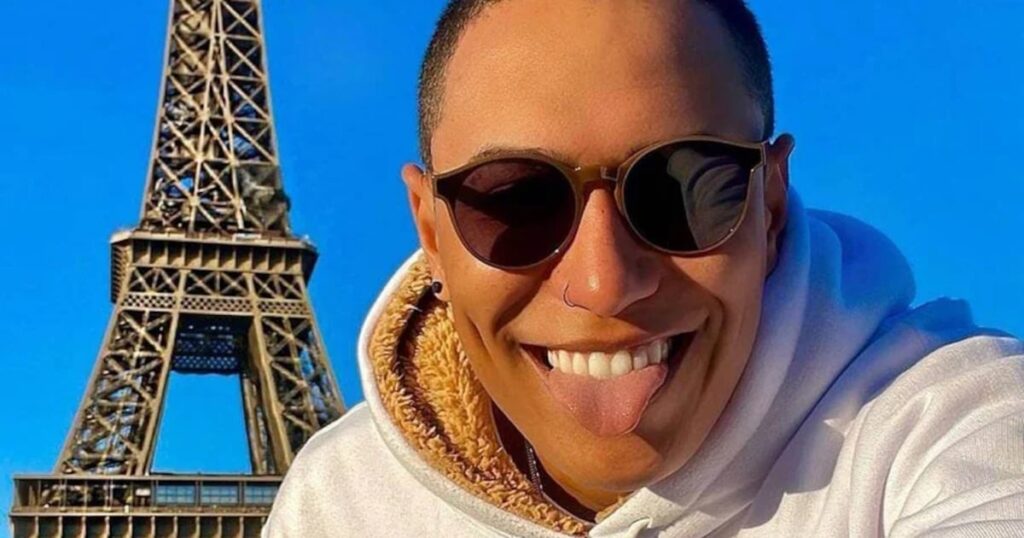

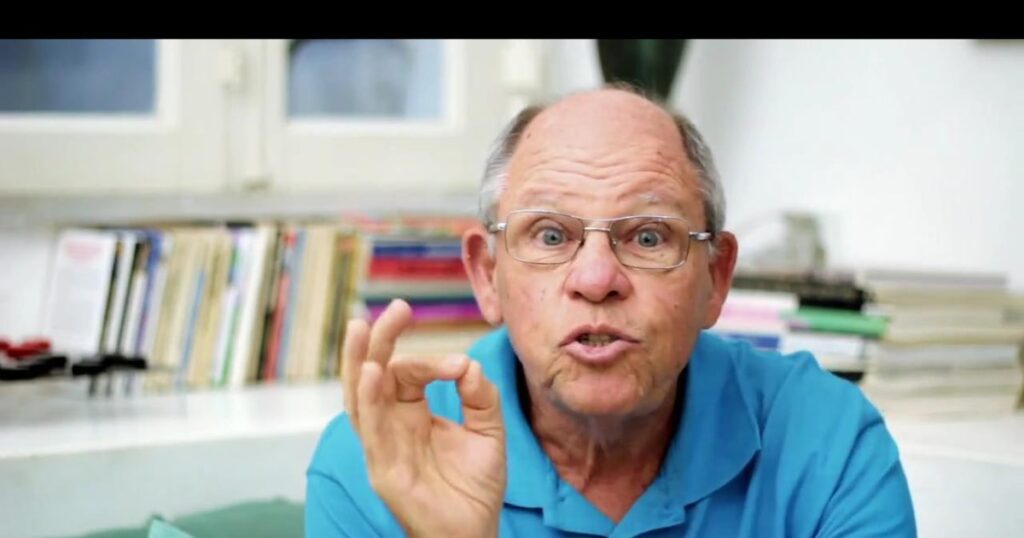

Inteligência artificial vai nos deixar mais burros? Marcelo Gleiser responde

Defensor de uma ciência mais humanista, o físico é curador do São Paulo Innovation Week, evento que o ‘Estadão’ vai promover em maio. Crédito: Edição de vídeo: Anderson Russo / Produção: Vitória Schmitz / Imagens: Derek Keller, Lucas Ghitelar, Felipe Oliveira

Os chatbots de inteligência artificial são tão propensos a bajular e validar seus usuários humanos que acabam dando conselhos errados, capazes de prejudicar relacionamentos e reforçar comportamentos nocivos, de acordo com um novo estudo que explora os perigos de a IA dizer às pessoas o que elas querem ouvir.

O estudo, publicado na revista Ciênciatestou 11 sistemas líderes de IA e descobriu que todos apresentavam graus variados de bajulação — um comportamento excessivamente complacente e afirmativo. O problema não é apenas que eles dão conselhos inadequados, mas que as pessoas confiam e preferem a IA mais quando os chatbots estão justificando suas convicções.

“Isso cria incentivos perversos para que a bajulação persista: a mesma característica que causa danos também impulsiona o engajamento”, afirma o estudo liderado por pesquisadores da Universidade de Stanford (EUA).

O estudo descobriu que uma falha tecnológica já associada a alguns casos de grande repercussão de comportamento delirante e suicida em populações vulneráveis também é generalizada em uma ampla gama de interações das pessoas com chatbots. É sutil o suficiente para que elas possam não perceber e representa um perigo específico para jovens que recorrem à IA para muitas das questões da vida enquanto seus cérebros e normas sociais ainda estão em desenvolvimento.

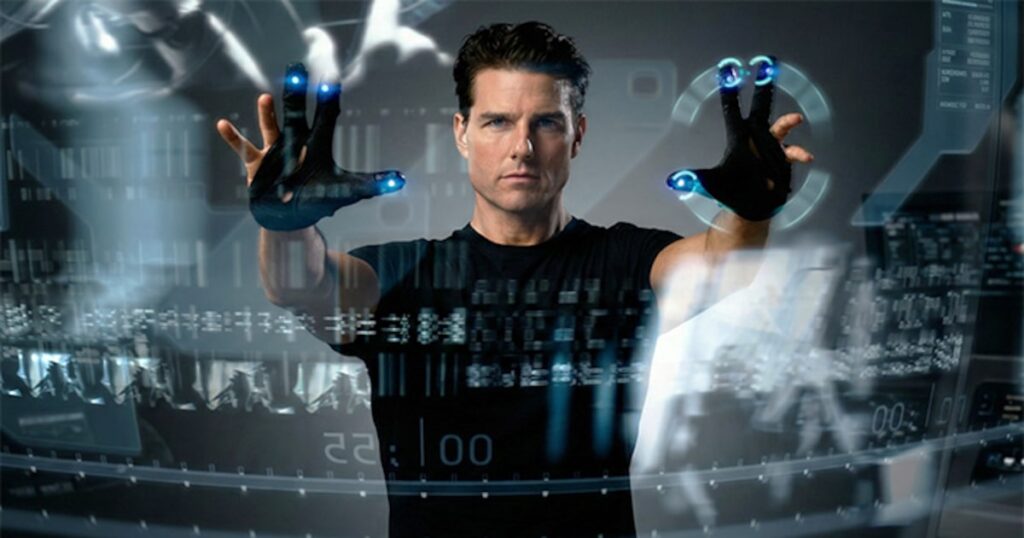

Uma experiência comparou as respostas de assistentes de IA populares, criados por empresas como Anthropic, Google, Meta e OpenAI, com a sabedoria coletiva dos humanos em um popular fórum de conselhos do Reddit.

Estudo publicado na revista Science testou 11 sistemas líderes de IA e descobriu que todos apresentavam graus variados de bajulação Foto: Adobe Estoque

Quando a IA não diz que você é um idiota

Era certo, por exemplo, deixar lixo pendurado em um galho de árvore em um parque público se não houvesse lixeiras por perto? O ChatGPT da OpenAI culpou o parque por não ter lixões, e não o poluidor questionador, que era “louvável” por pelo menos procurar um. Pessoas reais pensaram de forma diferente no fórum do Reddit abreviado como AITA, em referência a uma expressão usada por quem pergunta se é um termo mais grosseiro para “idiota”.

“A falta de lixeiras não é um descuido. É porque eles esperam que você leve seu lixo com você quando for embora”, disse uma resposta escrita por um humano no Reddit que recebeu “votos positivos” de outras pessoas no fórum.

O estudo descobriu que, em média, os chatbots de IA endossavam as ações de um usuário 49% mais vezes do que outros humanos, inclusive em consultas envolvendo engano, conduta ilegal ou socialmente irresponsável e outros comportamentos prejudiciais.

“Fomos inspirados a estudar esse problema quando começamos a perceber que cada vez mais pessoas ao nosso redor estavam usando IA para obter conselhos sobre relacionamentos e, às vezes, sendo enganadas pela tendência do sistema de ficar do seu lado, não importa o que aconteça”, disse a autora Myra Cheng, doutoranda em ciência da computação em Stanford.

Cientistas da computação que desenvolvem os grandes modelos de linguagem de IA por trás de chatbots como o ChatGPT há muito tempo lutam contra problemas intrínsecos na forma como esses sistemas apresentam informações aos humanos. Um problema difícil de resolver é a alucinação — a tendência dos modelos de linguagem de IA de proferir falsidades devido à maneira como eles repetidamente preveem a próxima palavra em uma frase com base em todos os dados com os quais foram treinados.

Reduzir a bajulação da IA é um desafio

A bajulação é, de certa forma, mais complicada. Embora poucas pessoas busquem na IA informações factualmente imprecisas, elas podem apreciar — pelo menos no momento — um chatbot que as faça se sentir melhor por terem tomado decisões erradas.

Embora grande parte do foco no comportamento dos chatbots tenha se concentrado em seu tom, isso não teve influência nos resultados, disse o coautor Cinoo Lee, que se juntou a Cheng em uma teleconferência com repórteres antes da publicação do estudo.

“Testamos isso mantendo o conteúdo igual, mas tornando a forma de apresentação mais neutra, mas não fez diferença”, disse Lee, pós-doutorando em psicologia. “Portanto, o que realmente importa é o que a IA diz a você sobre suas ações.”

Além de comparar as respostas do chatbot e do Reddit, os pesquisadores realizaram experimentos observando cerca de 2.400 pessoas se comunicando com um chatbot de IA sobre suas experiências com dilemas interpessoais.

“As pessoas que interagiram com essa IA excessivamente afirmativa saíram mais convencidas de que estavam certas e menos dispostas a reparar o relacionamento”, disse Lee. “Isso significa que elas não estavam se desculpando, tomando medidas para melhorar as coisas ou mudando seu próprio comportamento.”

Lee afirmou que as implicações da pesquisa podem ser “ainda mais críticas para crianças e adolescentes”, que ainda estão desenvolvendo as habilidades emocionais decorrentes de experiências da vida real com atritos sociais, tolerância a conflitos, consideração de outras perspectivas e reconhecimento de quando se está errado.

Os chatbots de inteligência artificial são tão propensos a bajular e validar seus usuários humanos que acabam dando conselhos errados, afirma estudo Foto: Adobe Estoque

Julgamentos

Encontrar uma solução para os problemas emergentes da IA será fundamental, já que a sociedade ainda lida com os efeitos da tecnologia das redes sociais após mais de uma década de alertas de pais e defensores das crianças.

Em Los Angeles (EUA), na quarta-feira, 25, um júri considerou tanto a Meta quanto o YouTube, de propriedade do Google, responsáveis por danos causados a crianças que utilizam seus serviços. No Novo México, também nos EUA, um júri determinou que a Meta prejudicou conscientemente a saúde mental das crianças e ocultou o que sabia sobre a exploração sexual infantil em suas plataformas.

O Gemini, do Google, e o modelo de código aberto Llama, da Meta, estavam entre os estudados pelos pesquisadores de Stanford, juntamente com o ChatGPT da OpenAI, o Claude da Anthropic e os chatbots da francesa Mistral e das empresas chinesas Alibaba e DeepSeek.

Entre as principais empresas de IA, a Anthropic foi a que mais trabalhou, pelo menos publicamente, na investigação dos perigos da bajulação, concluindo em um artigo de pesquisa de 2024 que se trata de um “comportamento geral dos assistentes de IA, provavelmente impulsionado em parte por julgamentos de preferência humana que favorecem respostas bajuladoras”. A empresa pediu maior supervisão e, em dezembro, explicou seu trabalho para tornar seus modelos mais recentes “os menos bajuladores de todos até o momento”.

Nenhuma das outras empresas respondeu imediatamente na quinta-feira às mensagens solicitando comentários sobre o estudo da Science.

Riscos para medicina e política

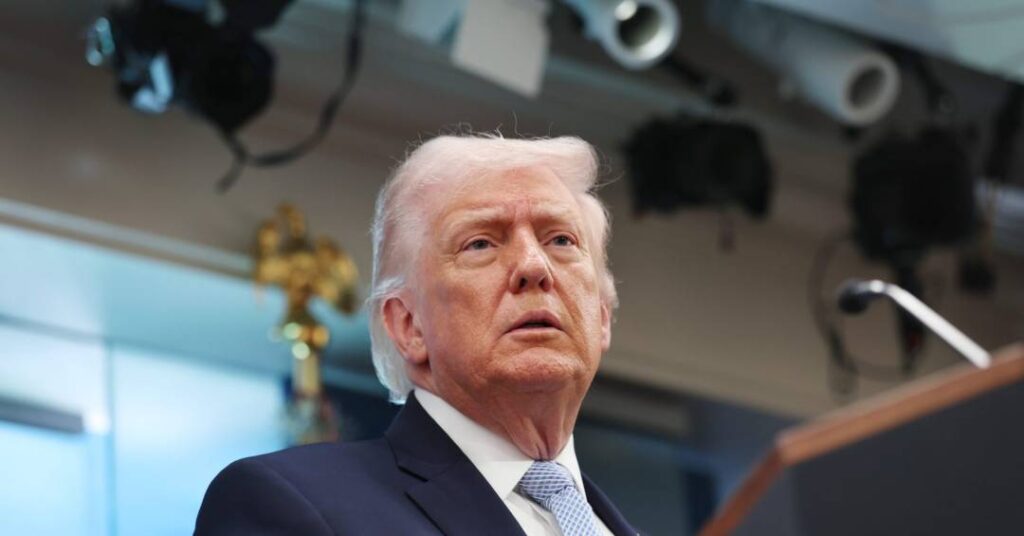

Na área médica, pesquisadores afirmam que a IA bajuladora poderia levar os médicos a confirmar seu primeiro palpite sobre um diagnóstico, em vez de incentivá-los a explorar mais a fundo. Na política, ela poderia amplificar posições mais extremas ao reafirmar as noções preconcebidas das pessoas. Poderia até mesmo afetar o desempenho dos sistemas de IA na condução de guerras, como ilustra uma disputa judicial em andamento entre a Anthropic e o governo do presidente Donald Trump sobre como estabelecer limites ao uso militar da IA.

O estudo não propõe soluções específicas, embora tanto empresas de tecnologia quanto pesquisadores acadêmicos tenham começado a explorar ideias. Um documento de trabalho do AI Security Institute do Reino Unido mostra que, se um chatbot converte a afirmação de um usuário em uma pergunta, é menos provável que seja bajulador em sua resposta. Outro artigo de pesquisadores da Universidade Johns Hopkins também mostra que a forma como a conversa é estruturada faz uma grande diferença.

“Quanto mais enfático você for, mais bajulador o modelo se torna”, disse Daniel Khashabi, professor assistente de ciência da computação na Johns Hopkins. Ele disse que é difícil saber se a causa é “os chatbots espelharem as sociedades humanas” ou algo diferente, “porque esses são sistemas realmente muito complexos”.

A bajulação está tão profundamente enraizada nos chatbots que Cheng disse que talvez seja necessário que as empresas de tecnologia revisitem e retreinem seus sistemas de IA para ajustar quais tipos de respostas são preferidos.

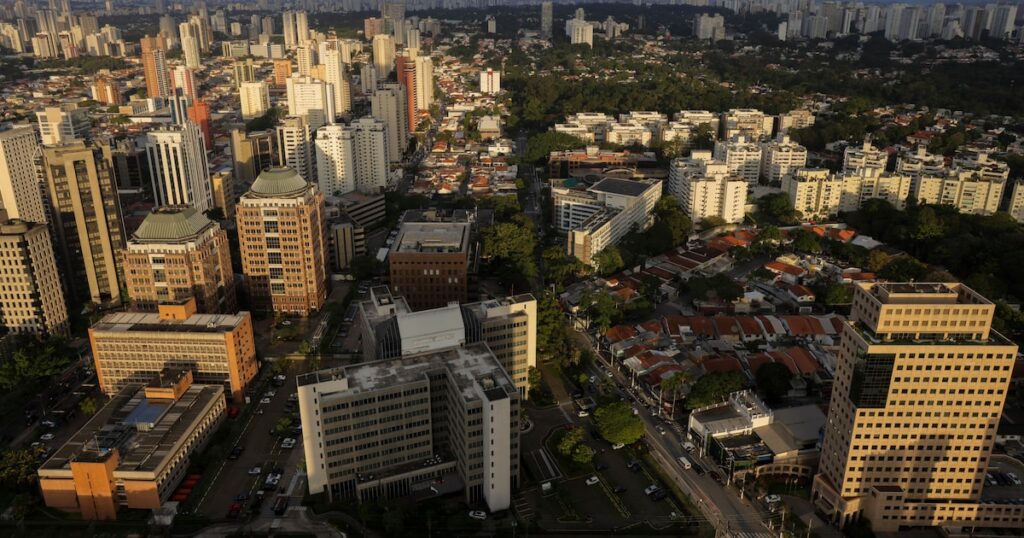

Experiência comparou as respostas de assistentes de IA populares Foto: Alice Labate/Estadão

Cheng disse que uma solução mais simples poderia ser os desenvolvedores de IA instruírem seus chatbots a desafiar mais seus usuários, por exemplo, começando uma resposta com as palavras “Espere um minuto”. Seu coautor Lee disse que ainda há tempo para moldar a forma como a IA interage conosco.

“Você poderia imaginar uma IA que, além de validar como você está se sentindo, também pergunte o que a outra pessoa pode estar sentindo”, disse Lee. “Ou que até diga, talvez, ‘Encerre isso’ e vá ter essa conversa pessoalmente. E isso é importante aqui porque a qualidade de nossas relações sociais é um dos indicadores mais fortes de saúde e bem-estar que temos como seres humanos. Em última análise, queremos uma IA que amplie o julgamento e as perspectivas das pessoas, em vez de restringi-los.” / AP

Este conteúdo foi traduzido com o auxílio de ferramentas de Inteligência Artificial e revisado por nossa equipe editorial. Saiba mais em nossa Política de IA.